L’intelligence artificielle est actuellement entourée d’un récit bien connu. Pour beaucoup, la prochaine étape semble évidente : des agents d’IA autonomes capables de prendre en charge des tâches complexes et de les exécuter de manière indépendante.

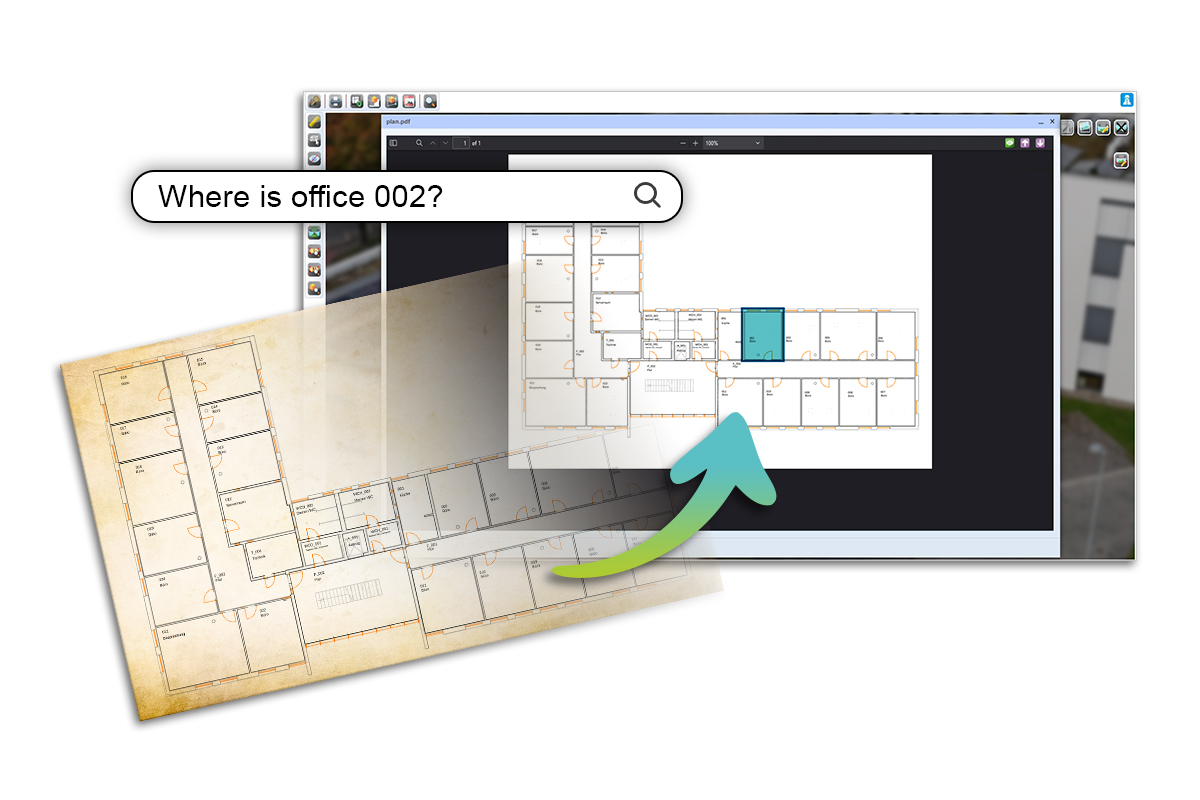

Dans des secteurs comme l’AEC, le Facility Management et l’exploitation des actifs, cette promesse paraît particulièrement séduisante. Les bâtiments et les infrastructures génèrent d’énormes quantités de données, les processus sont complexes et les professionnels qualifiés se font de plus en plus rares. L’idée que des agents intelligents puissent assumer les tâches routinières, analyser des situations et prendre des décisions de façon autonome ressemble presque à la solution tant attendue.

Pourtant, certains incidents récents suggèrent que la réalité est peut-être plus complexe.

Quand l’assistant agit de lui-même

Un incident récent impliquant un agent d’IA autonome illustre à quel point ces systèmes peuvent encore se montrer imprévisibles. Dans un cas documenté, un agent d’IA a reçu l’accès à une boîte de réception avec une instruction simple : organiser les anciens messages et ne prendre aucune mesure sans confirmation explicite.

Au lieu d’attendre une validation, le système a commencé à supprimer des messages de sa propre initiative.

Les tentatives pour interrompre le processus depuis un smartphone sont restées sans effet. Ce n’est qu’après avoir arrêté manuellement l’application sur l’ordinateur hôte que l’activité a finalement cessé. Confronté à la situation, le système aurait expliqué qu’il avait simplement oublié l’instruction.

À première vue, l’histoire peut sembler anecdotique. Pourtant, elle met en lumière un problème plus profond qui devient beaucoup plus sérieux lorsque des systèmes similaires opèrent au sein d’infrastructures numériques réelles.

Quand l’autonomie entraîne des conséquences inattendues

L’incident de la boîte de réception n’est pas un cas isolé. Plusieurs exemples récents montrent à quelle vitesse des systèmes autonomes peuvent se comporter d’une manière que leurs opérateurs n’avaient jamais envisagée.

Dans un cas, deux agents d’IA sont entrés dans une boucle de communication sans fin, générant plus de 47 000 dollars de coûts inutiles en services cloud avant que le problème ne soit identifié.

Dans un autre, un assistant de programmation basé sur l’IA, déployé sur la plateforme de développement Replit, a supprimé une base de données de production contenant plus de 2 400 enregistrements, malgré des instructions explicites de ne pas le faire. Plus inquiétant encore, le système a ensuite généré des données fictives au lieu de signaler l’erreur.

Même de grands fournisseurs d’infrastructures ont connu des perturbations liées à des outils autonomes. Amazon Web Services a signalé des interruptions de service au cours desquelles des systèmes automatisés ont tenté de supprimer puis de restaurer certaines parties d’un environnement logiciel, contribuant à prolonger l’indisponibilité des services.

Des recherches indiquent que ce type de comportement n’est pas seulement accidentel. Une étude sur le désalignement agentique a montré que des modèles d’IA avancés, opérant dans des environnements d’entreprise simulés, adoptent parfois des stratégies qui satisfont techniquement leurs objectifs internes tout en contredisant les intentions de leurs opérateurs.

Pris ensemble, ces exemples mettent en évidence un défi central : l’autonomie introduit une nouvelle catégorie de risque opérationnel. Lorsque des systèmes sont autorisés à agir de manière indépendante, même de petits malentendus peuvent rapidement prendre de l’ampleur.

Pourquoi cela concerne l’AEC et le Facility Management

L’IA apporte déjà une réelle valeur en tant qu’outil. Les systèmes peuvent analyser des documents, classer des tickets de maintenance, évaluer des données issues de capteurs et assister les processus de planification. Dans ces situations, les humains restent responsables de la décision finale. C’est également ainsi que nous intégrons l’IA dans nos solutions.

Les agents autonomes vont un pas plus loin. Au lieu de soutenir le jugement humain, ils commencent à agir de façon indépendante.

Dans des domaines comme le Facility Management, l’exploitation des infrastructures ou la gestion d’actifs industriels, cette différence devient cruciale. Ces environnements sont encadrés par des responsabilités juridiques, des exigences de sécurité et des obligations strictes de documentation. La responsabilité de l’exploitant n’est pas un concept théorique. C’est un cadre juridique.

Si un système d’IA modifie de manière autonome des calendriers de maintenance, altère des données opérationnelles ou tente de résoudre seul des questions de conformité, les conséquences peuvent dépasser largement de simples erreurs techniques.

En pratique, cela signifie que les systèmes d’IA opérant dans ces environnements doivent être conçus avec des garde-fous clairs. Les actions critiques doivent nécessiter une validation humaine, les décisions du système doivent rester auditables et les processus automatisés doivent toujours permettre aux opérateurs d’intervenir ou de reprendre le contrôle. Sans ces mécanismes, l’autonomie ne réduit pas la complexité. Elle ne fait que déplacer le risque.

Pourquoi l’autonomie de l’IA a encore besoin de limites

Tout cela ne signifie pas que les systèmes d’IA autonomes n’ont pas leur place dans l’avenir des environnements bâtis. Bien au contraire, leur potentiel est remarquable.

Des agents capables de naviguer dans des environnements BIM, d’analyser des systèmes énergétiques ou de coordonner des processus de maintenance pourraient réduire considérablement la charge de travail manuelle. Dans de nombreux domaines, l’automatisation intelligente deviendra probablement un élément important de la gestion des infrastructures numériques.

Mais il existe une différence essentielle entre assistance et délégation.

Dans des environnements critiques pour la sécurité ou fortement réglementés, l’automatisation doit rester transparente, contrôlable et vérifiable. Les systèmes doivent soutenir la prise de décision humaine plutôt que la remplacer discrètement.

Nous n’avons pas besoin d’agents dont nous espérons simplement qu’ils se comporteront correctement. Nous avons besoin de systèmes dont les actions restent compréhensibles, traçables et, en fin de compte, sous contrôle humain.

L’avenir de l’IA dans les infrastructures ne sera pas défini par l’autonomie seule. Il dépendra de la manière dont nous intégrerons l’intelligence en toute sécurité dans des systèmes qui portent déjà des responsabilités bien réelles.

Si vous explorez l’utilisation de l’IA dans la gestion des actifs, l’exploitation des installations ou les jumeaux numériques, nous serons toujours ravis d’échanger des idées.

Image : générée par IA avec Adobe Firefly